NVIDIA A100 和 A800 Tensor Core GPU 提供出色的加速和灵活性,为全球性能最高的 AI、数据分析和 HPC 应用弹性数据中心提供支持。作为 NVIDIA 数据中心平台的引擎,A100 和 A800 的性能比 V100 GPU 高出 20 倍,并且可以有效地扩展到数千个 GPU,或者利用新的多实例 GPU (MIG) 功能划分为 7 个独立的 GPU 实例加速各种规模的工作负载。 A800 仅在中国大陆、香港和澳门销售。A100 在所有其他市场均有销售。A100 和 A800 之间的唯一区别是 NVLink 接口的速度:A100 上的 NVLink 运行速度为 600 GB/s,而 A800 上的 NVLink 运行速度为 400 GB/s。 第三代 Tensor Core 技术支持广泛的数学精度,为数据分析、AI 训练、AI 推理和 HPC 提供统一的工作负载加速器。在一个平台上加速纵向扩展和横向扩展工作负载,使弹性数据中心能够动态调整以适应不断变化的应用程序工作负载需求。这同时提高了吞吐量并降低了数据中心的成本。

PCIe 选件部件号包括以下内容: ◆ 一个 NVIDIA A100 GPU,附有全高 (3U) 适配器支架 ◆ 文档

不带 CEC 芯片的 GPU:NVIDIA A100 GPU 不带 CEC 芯片(在名称中查找“w/o CEC”)。CEC 是辅助硬件信任根 (RoT) 模块,提供额外的安全层,可供具有高监管要求或高安全标准的客户使用。NVIDIA 使用多层安全模型,因此 GPU 中嵌入的主要信任根提供的保护预计足以满足大多数客户的需求。CEC 失败的产品仍然提供安全启动、安全固件更新、固件回滚保护和带内固件更新禁用功能。具体来说,如果没有 CEC 芯片,GPU 不支持密钥撤销或固件证明。现场升级时,同一类型GPU的CEC和非CEC GPU可以混合使用。特征 NVIDIA A100 Tensor Core GPU 在各个规模上都能提供前所未有的加速,为全球性能最高的弹性数据中心提供支持,用于人工智能、数据分析和高性能计算 (HPC) 应用程序。作为 NVIDIA 数据中心平台的引擎,A100 的性能比上一代 NVIDIA Volta™ 高出 20 倍。A100 可以通过多实例 GPU (MIG) 高效扩展或划分为 7 个独立的 GPU 实例,提供统一的平台,使弹性数据中心能够动态调整以适应不断变化的工作负载需求。

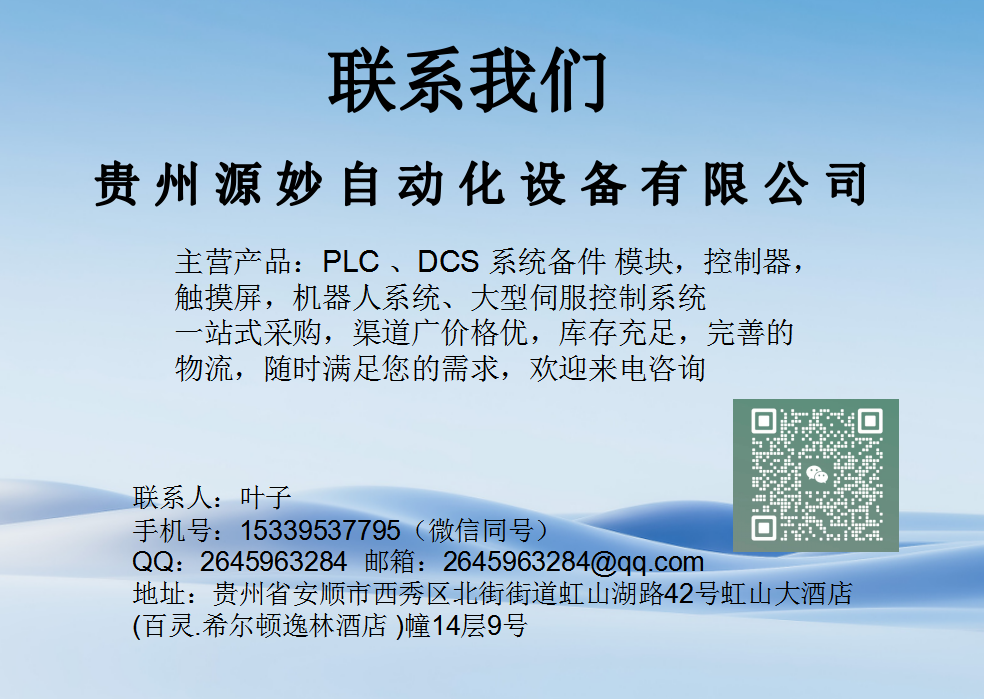

如果您需要咨询或购买,请将产品型号发送到我的邮箱或直接打电话给我。

NVIDIA A100 Tensor Core 技术支持广泛的数学精度,为每种工作负载提供单一加速器。最新一代 A100 80GB 使 GPU 内存翻倍,并以每秒 2 太字节 (TB/s) 的速度推出了全球最快的内存带宽,加快了最大模型和最海量数据集的解决时间。 A100 是完整 NVIDIA 数据中心解决方案的一部分,该解决方案融合了 NVIDIA NGC™ 目录中的硬件、网络、软件、库以及优化的 AI 模型和应用程序的构建块。它代表了数据中心最强大的端到端人工智能和高性能计算平台,使研究人员能够提供真实的结果并将解决方案大规模部署到生产中。 ◆ NVIDIA 安培架构 无论是使用 MIG 将 A100 GPU 划分为较小的实例,还是使用 NVLink 连接多个 GPU 以加速大规模工作负载,A100 都可以轻松处理不同规模的加速需求,从最小的作业到最大的多节点工作负载。A100 的多功能性意味着 IT 经理可以全天候最大限度地利用数据中心中每个 GPU 的效用。 ◆ 第三代张量核心 NVIDIA A100 可提供 312 兆浮点运算 (TFLOPS) 的深度学习性能。与 NVIDIA Volta GPU 相比,深度学习训练的 Tensor 每秒浮点运算次数 (FLOPS) 是 20 倍,深度学习推理的每秒 Tensor 万亿次运算 (TOPS) 是 20 倍。 ◆ 下一代 NVLink 与上一代相比,A100 中的 NVIDIA NVLink 吞吐量提高了 2 倍。与 NVIDIA NVSwitch 结合使用时,最多可以将 16 个 A100 GPU 以高达 600 GB/秒 (GB/秒) 的速度互连,从而在单个服务器上释放出最高的应用程序性能。NVLink 可通过 HGX A100 服务器主板在 A100 SXM GPU 中使用,并可通过最多 2 个 GPU 的 NVLink 桥在 PCIe GPU 中使用。 ◆ 多实例 GPU (MIG) A100 GPU 可以划分为多达 7 个 GPU 实例,这些实例在硬件级别上完全隔离,具有自己的高带宽内存、缓存和计算核心。MIG 使开发人员能够为其所有应用程序实现突破性的加速,而 IT 管理员可以为每项作业提供适当大小的 GPU 加速,从而优化利用率并扩展对每个用户和应用程序的访问。 ◆ 高带宽内存 (HBM2E) A100 拥有高达 80 GB 的 HBM2e,可提供超过 2TB/s 的全球最快 GPU 内存带宽,以及 95% 的 DRAM 使用效率。A100 的内存带宽比上一代高出 1.7 倍。 ◆ 结构稀疏性 人工智能网络拥有数百万至数十亿个参数。准确预测并不需要所有这些参数,有些参数可以转换为零,使模型“稀疏”而不影响准确性。A100 中的 Tensor Core 可为稀疏模型提供高达 2 倍的性能提升。虽然稀疏性特征更容易有利于人工智能推理,但它也可以提高模型训练的性能。

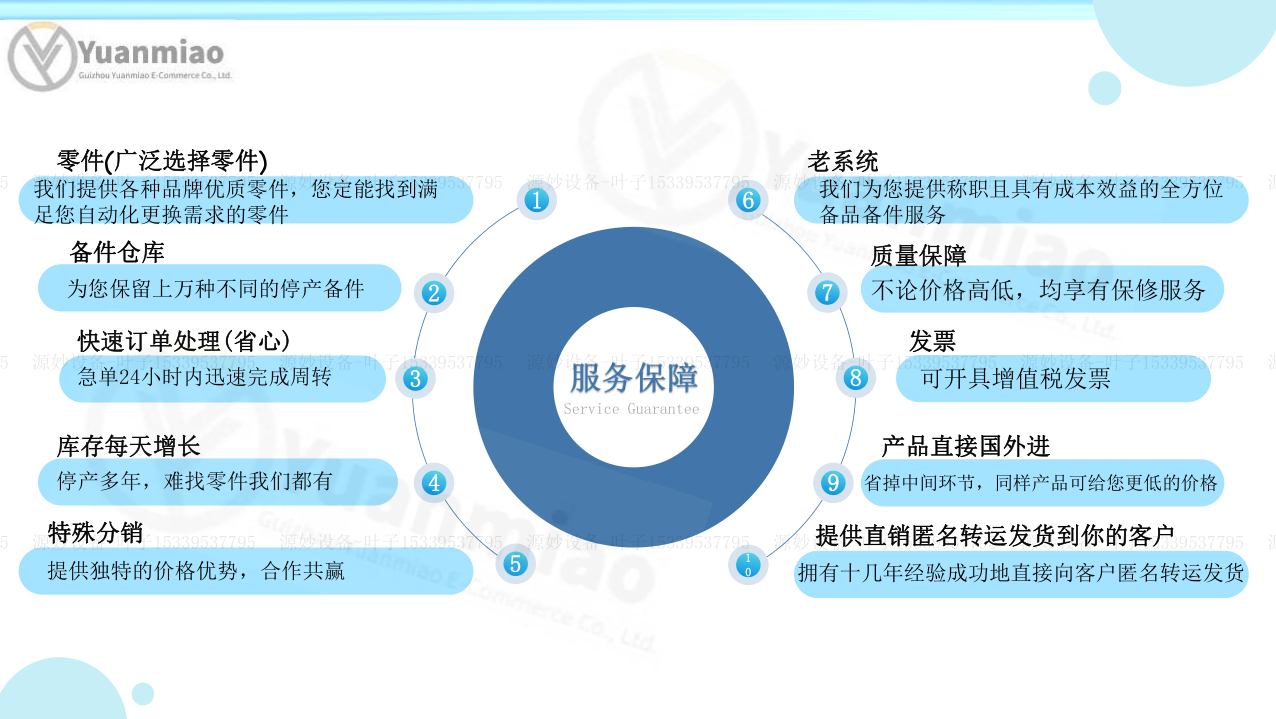

公司专注于DCS、PLC、机器人、大型伺服四大系统

主要产品有各种模块/卡、控制器、触摸屏、伺服驱动器 公司优势:供应进口原装产品,专业生产配件 保修一年,交货时间快,货源齐全!!! ① 24小时邮件回复(12小时); ② 装运到亚洲以外的国家,请与卖方联系。

Related Products

| ENTERASYS A2H124-24FX-RH | SEW 31C030-503-4-00 |

| ENTERASYS SSA-G1018-0652 | SEW 31C055-503-4-00 |

| VMIC VME7740-841 | SEW 31C075-503-4-00 |

| VMIC VMIPMC-5565 | SEW 31C450-503-4-00 |

| VMIC VMIVME-3122 | VIBRO 200-510-111-013 |

| VMIC VMIVME-7452 | VIBRO 200-560-101-015 |

| VMIC VMIVME7740-841 | VIBRO 200-566-101-012 |

| VMIC VMIVME-7750 | VIBRO 200-595-002-011 |

【免责声明】

我司销售新产品和停产产品,独立渠道购买此类特色产品。贵州源妙自动化设备有限公司不是本网站特色产品的授权分销商、经销商或代表。本网站上使用的所有产品名称/产品图片、商标、品牌和微标均为其各自所有者的财产带有这些名称图片、商标、品牌和徽标的产品描述、描写或销售仅用于识别目的,并不表示与任何权利持有人有任何关联或授权。

本文来自贵州源妙自动化设备有限公司官方网站请附上此链接:http://www.ymbmy.com/

15339537795